2.3.4 Audition binaurale et localisation auditive39

Pour construire notre espace sonore subjectif, il nous faut

tout d'abord repérer la position des sources acoustiques qui nous

entourent. Cette opération est désignée sous le nom de

«localisation». Localiser une source, c'est d'abord identifier son

azimut et sa hauteur, donc sa direction, puis déterminer la distance

à laquelle elle se trouve dans cette direction. L'environnement

acoustique résulte en général de l'action

simultanée de plusieurs sources. La combinaison de leurs rayonnements

produit un champ acoustique complexe que le système auditif doit traiter

pour reconna»tre séparément chaque source. Nous examinerons

ce problème à partir des exemples de la

stéréophonie, de l'effet de Haas et de la localisation dans le

bruit. Ce dernier point nous permettra de définir ce que l'on appelle le

démasquage binaural et de préciser les facultés de

discrimination auditive spatiale qui en découlent.

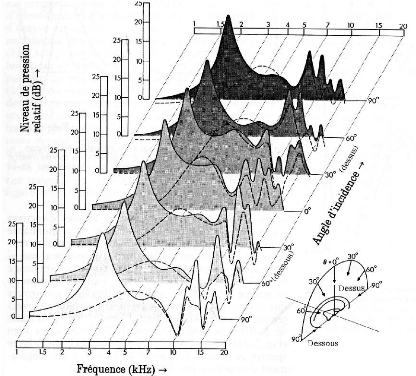

Niveau de pression acoustique dans le conduit auditif,

rapporté à la pression sur un plan réfléchissant,

en fonction de la fréquence, pour diverses incidences.

( - ) au voisinage du tympan ; (---) à l'entrée

(2cm) du conduit auditif «obturé». (Shaw et Teranishi,

1968)

2.3.5 Perception de la musique

40

Parmi tous les sons don't le système auditif humain est

capable d'extraire une sensation de HT, les plus importants

écologiquement sont complexes et périodiques. Tel est le cas des

voyelles et des sons que produisent la plupart des instruments de musique. En

vertu de théorème de Fourier, tout son complexe périodique

(SCP) de période p = 1/f peut être décrit

comme une somme de sons purs qui diffèrents par la fréquence et

dont chacun a une fréquence de la forme n.f, ou n est

un nombre entier ; la fréquence f est appelée

«fréquence fondamentale» du SCP. Les SCP typiques de

l'environnement sonore humain sont des SCP «harmoniques». Un SCP de

fréquence fondamentale f est dit «harmonique» lorsque

les sons purs constituant ses composantes spectrales ont des fréquences

qui sont des multiples entiers successifs de f : dans son spectre,

chaque composante de fréquence n.f (sauf la dernière)

est suivie d'une composante de fréquence (n + 1).f.

Tout autre SCP est «inharmonique».

41

La musique a une emprise constante sur notre activité.

Le fait que l'oreille fonctionne en permanence, offre la possibilité au

stimuleur d'attirer l'attention de l'auditeur par une source quelconque. Ici,

elle n'est pas quelconque puisqu'il s'agit de musique, immédiatement

l'auditeur y prête attention avec un degré de conscience plus ou

moins grand. Cette intensité d'attention de l'auditeur par rapport

à ce qu'il écoute varie suivant si la musique qu'il percoit lui

évoque un intérêt quelconque ou pas dutout.

La musique a trois fonctions : affective, cognitive,

comportementale.

L'affectif est l'effet plus ou moins produit

directement sur l'auditeur. La musique doit correspondre aux gouts musicaux du

client afin de leur procurer du plaisir.

Le cognitif traduit des faits propre à

la musique, comme l»%oge, la classe socio/professionnelle, la

géographie... Ainsi, suivant la musique que l'on décide de

programmer, celle-ci évoquera des repéres assez clairs sur un

certain positionnement, à savoir à qui s'adresse cette musique et

qui est suceptible d'y être sensible et de l'interpréter comme une

composante logique du lieu. L'exemple des magasins pour adolescentes Pimkie est

encore une fois trés parlant, il est en effet totalement hors sujet de

diffuser de la musique classique dans ce genre d'endroit tant les jeunes gens

ne se retrouveront pas dans cette musique associée à leur

magasin.

Le comportemental est l'action physique produite

par la musique. La musique peut alors ralentir le rythme de la visite

du magasin, détendre en installant une ambiance confortable

ou au contraire donner du dynamisme et une

énergie au client.

Malgré tout, la littérature entretient

l'infériorité de l'ou

·e par rapport aux autres sens.

A propos du mépris de l'oreille :

«Citation d'Horace traduit par le père

Sanadon : Ce qui ne frappe que les oreilles fait moins d'impression que ce qui

frappe les yeux. Quignard poursuit Théophraste soutenait au contraire

que le sens qui ouvrait la porte le plus largement aux passions était la

perception acoustique.»42

«Tout son est l'invisible sous la forme du

perceur d'enveloppes. (É) Immatériel, il franchit toutes les

barrières. Le son ignore la peau, ne sait pas ce qu'est une limite : il

n'est ni interne, ni externe. Illimitant, il est inlocalisable. Il ne peut

être touché : il est l'insaisissable. L'audition n'est pas comme

la vision. Ce qui est vu peut être aboli par les paupières, peut

être arrêté par la cloison ou la tenture, peut être

rendu aussitôt inaccessible par la muraille. Ce qui est entendu ne

conna»t ni paupières, ni cloisons, ni tentures, ni murailles.

Indélimitable, nul ne peut s'en protéger. (É) Le son

s'engouffre. Il est le violeur. L'ou

·e est la perception la plus

archa

·que au cours de l'histoire personnelle, avant même

l'odeur, bien avant la vision, et s'allie à la nuit.

Il se trouve que l'infini de la passivité (la

réception contrainte invisible) se fonde dans l'audition humaine.

(É) Entendre, c'est être touché à distance. Le

rythme est lié à la vibration. C'est en quoi la musique rend

involontairement intime des corps

juxtaposés.»43

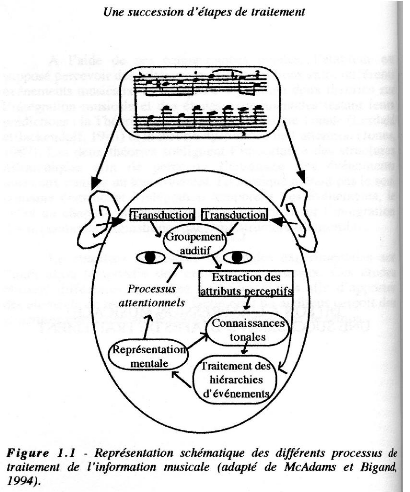

«Les découvertes récentes de la

neurologie confirment bien cette différence entre musique et langage en

localisant le traitement de la musique dans le cerveau dans un tout autre lieu.

Alors que le traitement du langage est nettement localisé dans

l'hémisphère cérébral gauche, celui de la musique

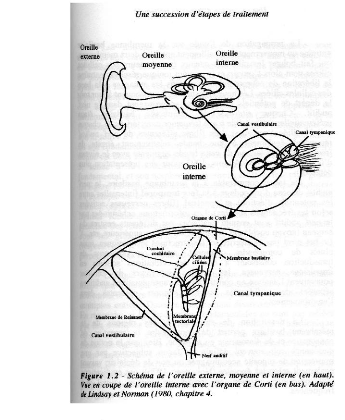

est beaucoup plus complexe. Une vibration sonore pénètre par le

pavillon de l'oreille sous forme d'onde ; quand elle atteint le tympan, elle se

transforme en oscillations de la membrane fermant le conduit auditif,

transmises par des osselets à l'oreille interne, jusqu'à une

cavité emplie de liquide oü se trouvent quelque deux cent mille

cellules cillées qui transforment les vibrations en substances

chimiques. Celles-ci exitent à leur tour les terminaisons du nerf

auditif qui les transforment en signaux électriques circulant alors

jusqu'au cortex oü s'opèrent l'analyse et la reconnaissance.

Là se distingue musique et langage : il semble que l

l'appréhension de la courbe mélodique se fasse tout

entière dans l'hémisphère droit, alors que la localisation

de celle du rhythme reste encore mystérieuse. Les sensations musicales

sont ensuite regroupées, analysées, comparées à un

lexique sonore gardé quelque part en mémoire, lequel les

reconna»t s'il les a déjà entendues, ou du moins les

confrontes à des sons, des timbres, des rhythmes, des mélodies

déjà mémorisés. On peut réentendre

virtuellement un son en mémoire rien qu'en y pensant ; on peut en

quelque sorte le fredonner dans son esprit : phénomnèse.

Lorsqu'on réentend une oeuvre mémorisée, on n'entend pas

l'oeuvre, mais aussi tout le contexte dans lequel on l'a déjà

entendue, réellement et virtuellement. Un climat sonore, un

environnement musical, une mélodie peuvent alors être

associés à une ambiance, une signification, un discours, pour

suggérer des sentiments, manifester des intentions, des ordres,

compléter ce que disent les images, inciter à une

chorégraphie.

La mémoire des sons, essentielle à

l'intelligence de la musique, s'organise dès la prime enfance. Elle

varie considérablement d'un individu à l'autre. Certains n'en ont

aucune et sont même incapables d'associer le nom d'une note à un

son entendu mille fois tandis que d'autres peuvent rejouer de mémoire

des oeuvres d'une très grande longueur.»44

|